人工智能

约翰·麦卡锡:它是制造智能机器,特别是智能计算机程序的科学和工程。它与使用计算机理解人类智能的类似任务有关,但人工智能不必局限于生物学上可观察的方法。

马文·明斯基:“使计算机能够做一些当由人类完成时会被认为需要智力的事情”

艾伦·图灵($Alan$·$Turing$):被誉为计算机科学之父,他在 20 世纪早期提出了“图灵机”和“图灵测试”,对计算和人工智能的理论有深远影响。

约翰·麦卡锡($John$·$McCarthy$):他在 1956 年的达特茅斯会议上首次提出了“人工智能”这个术语,并成为了人工智能领域的早期领导者之一。

艾伦·纽厄尔($Allen$·$Newell$)和赫伯特·A·西蒙($Herbert$ $A. Simon$):他们在人工智能和认知科学领域做出了重要贡献,如逻辑理论和计算模型。

1943 年,神经学家$Warren$ $McCulloch$和数学家$Walter$ $Pitts$合著了《神经活动中固有的思维逻辑运算》($A$ $Logical$ $Calculus$ $of$ $the$ $Ideas$ $Immanent$ $in$ $Nervous$ $Activity$),书中提出将数学和算法的结合,建立了神经网络和数学模型,模仿人类的思维活动。人工神经网络的大门由此开启。这篇研究论文后来还催生了$Google$ 。

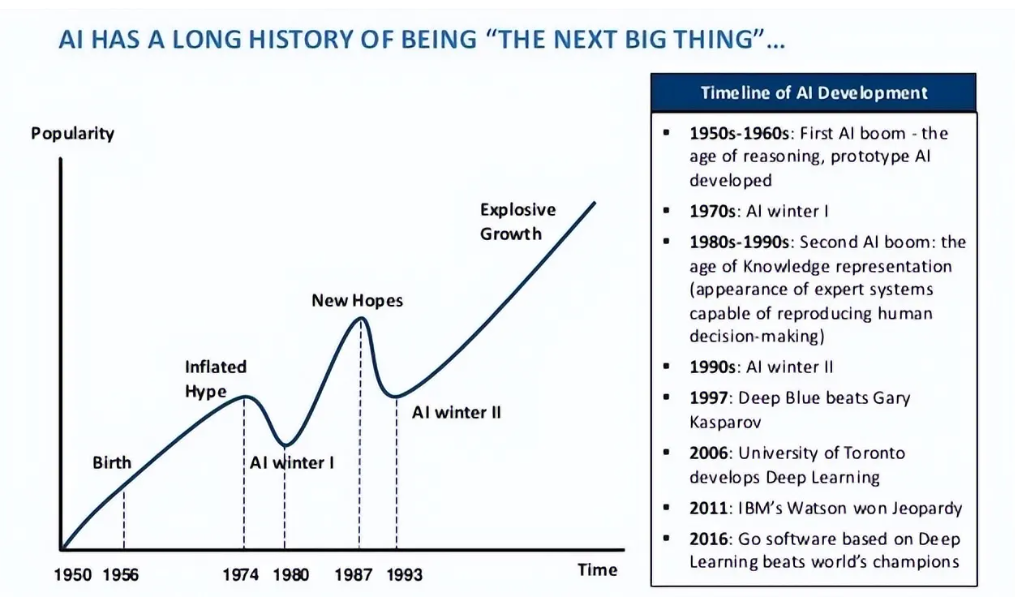

1955 年 8 月 31 日,“人工智能”这个词首次出现在一个持续 2 个月、只有 10 个人参加的研讨会提案上。提案撰写者包括$John$ $McCarthy$ ($Dartmouth$ $College$), $Marvin$ $Minsky$ ($Harvard$ $University$), $Nathaniel$ $Rochester$ ($IBM$), 和 $Claude$ $Shannon$ ($Bell$ $Telephone$ $Laboratories$)等人。其中,$John$ $McCarthy$被认为是“人工智能”这个词的创造者。

1956 年 $Dartmouth$ 会议被后世广泛承认为人工智能诞生的标志。会议上提出的断言之一是“学习或者智能的任何其他特性的每一个方面都应能被精确地加以描述,使得机器可以对其进行模拟。”这次会议上人工智能的名称和任务得以确定,同时出现了最初的成就和最早的一批研究者。

$ELIZA$是由$Joseph$ $Weizenbaum$在麻省理工学院开发的,这可能是世界上第一个聊天机器人,它也是$Alexa$和$Siri$等聊天机器人的直系祖先。$ELIZA$代表了自然语言处理的早期实现,其目的是教会计算机采用人类语言与人们交流,而不是要求人们采用计算机代码对它们进行编程,或通过用户界面进行交互。$ELIZA$不能像$Alexa$那样说话,而通过文本进行交流,而且它无法从与人类的对话中学习。尽管如此,它为以后突破人类与机器之间的沟通障碍的努力铺平了道路。

反向传播($backpropagation$)有时缩写为 $BACKPROP$,是一种与最优化方法(如梯度下降法)结合使用的,用于训练神经网络的常见方法,在机器学习史上是重要的算法之一。它最早是 $1969$ 年 $Marvin Minsky$ 和 $Seymour Papert$ 在《感知机》($Perceptrons$)中提出,但直到 20 世纪 80 年代中期,才成为机器学习的主流。

自动驾驶汽车的展示系统可追溯至 1920 年代及 1930 年代间,但要到 1950 年代从出现可行的实验,并取得部分成果。第一辆能真正自动驾驶的汽车则出现于 1980 年代。1984 年,卡内基美隆大学推动 $Navlab$ 计划与 $ALV$ 计划,这个被人搁置多年的想法又卷土重来,再到 1987 年,梅赛德斯-奔驰与德国慕尼黑联邦国防大学共同推行尤里卡普罗米修斯计划。从此以后,许多大型公司与研究机构开始制造可运作的自动驾驶汽车原型。

1989 年,美国卡内基梅隆大学的研究人员 $Dean$ $Pomerleau$就花费了 8 年的时间,研发出了一套名叫 $ALVINN$ ($Autonomous$ $Land$ $Vehicle$ $In$ $a$ $Neural$ $Network$) 的无人驾驶系统,并用在了 $NAVLAB$货车上,从宾夕法尼亚州匹兹堡到加州圣地亚哥行驶了 2797 英里,成功实现了自动驾驶,成为自动驾驶的祖师爷。虽然它的技术在今天来看非常原始,但是它证明了自动驾驶是可以实现的。

1996 年 2 月 10 日,超级电脑 $Deep$ $Blue$ 首次挑战国际象棋世界冠军 $Kasparov$ ,但以 2:4 落败。比赛在 2 月 17 日结束。其后研究小组把 $Deep$ $Blue$ 加以改良,1997 年 5 月再度挑战 $Kasparov$ ,比赛在 5 月 11 日结束,最终 $Deep$ $Blue$ 电脑以 3.5:2.5 击败 $Kasparov$ ,成为首个在标准比赛时限内击败国际象棋世界冠军的电脑系统。$IBM$ 在比赛后宣布 $Deep$ $Blue$ 退役。

李飞飞教授意识到了专家学者在研究算法的过程中忽视了“数据”的重要性,于是开始带头构建大型图像数据集—ImageNet,图像识别大赛由此拉开帷幕。

斯坦福大学和谷歌公司的研究人员(其中包括$Jeff$ $Dean$和$Andrew$ $Ng$)发表了名为 “使用大规模无监督学习构建高级特征”的论文,这是基于以前对多层神经网络(称为深度神经网络)的研究。他们的研究探索了无监督学习,这种学习可以在数据被用于训练机器学习算法之前,消除手工标记数据的昂贵而耗时的任务。

该论文描述了一种模型,该模型可以构建包含大约 10 亿个连接的人工网络。并承认,虽然这是向构建“人工大脑”迈出的重要一步,但仍有一些路要走——人类大脑中的神经元被认为是由大约 10 万亿个连接器组成的网络连接起来的。

2012 年,$Alex$ $Krizhevsky$、$Ilya$ $Sutskever$在多伦多大学$Geoff$ $Hinton$的实验室设计出了一个深层的卷积神经网络$AlexNet$,夺得了 2012 年$ImageNet$ $LSVRC$的冠军,且准确率远超第二名(top5 错误率为 15.3%,第二名为 26.2%),引起了很大的轰动。$AlexNet$可以说是具有历史意义的一个网络结构,在此之前,深度学习已经沉寂了将近 20 年,自 2012 年$AlexNet$诞生之后,后面的$ImageNet$冠军都是用卷积神经网络($CNN$)来做的,并且层次越来越深,使得$CNN$成为计算机视觉领域($CV$)的核心算法模型,在今后 20 年的发展中,$CNN$在$CV$的地位始终是统治性的,可以说$AlexNet$带来了深度学习的大爆发。

2016 年 3 月,$Google$ $DeepMind$ 的 $AlphaGo$ 在四场比赛中击败了围棋世界冠军李世石。全世界有 $6000$ 万观众观看了这场比赛。这是一个具有里程碑意义的事件,因为围棋中可能的落子位置数目比宇宙的原子总数还要多,把围棋所有的状态用穷举法全部列出大概需要 10¹⁷⁰(相比之下国际象棋只有 10⁴⁶),因此,围棋也被认为是人工智能攻克信息完全博弈游戏最后的堡垒。相比 1997 年 $IBM$ $Deep$ $Blue$ 的暴力博弈树遍历而言, $Deep$ $Blue$ 的胜利只是硬件速度的胜利和计算机的胜利。$AlphaGo $今天的胜利才真正是人工智能的胜利,它标志着真正人工智能时代的开启。

智能体$Agent$

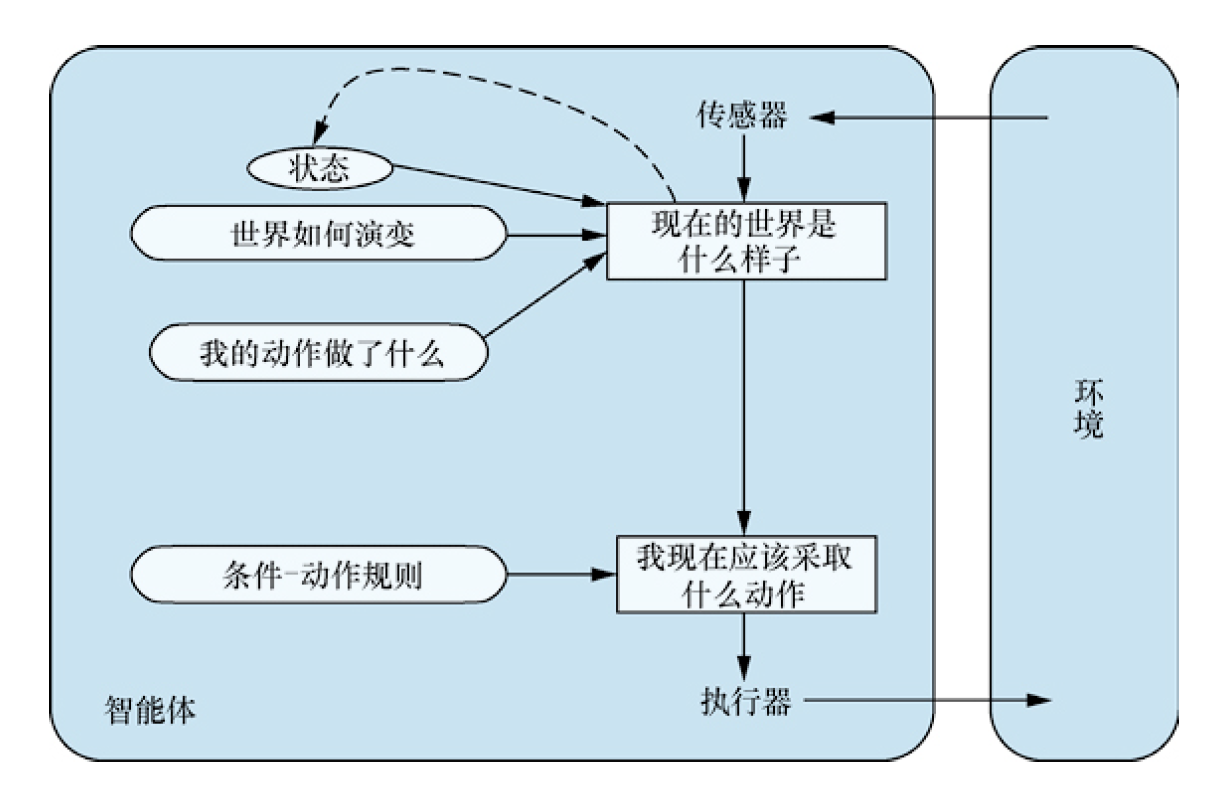

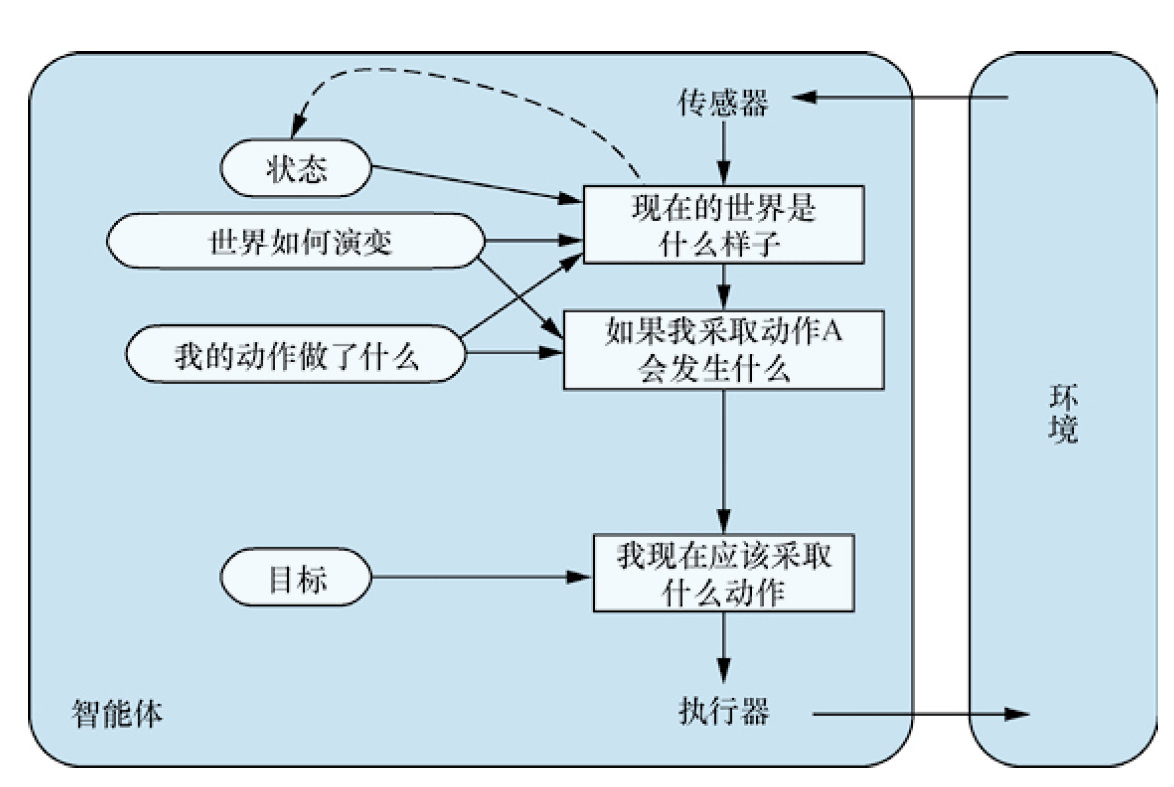

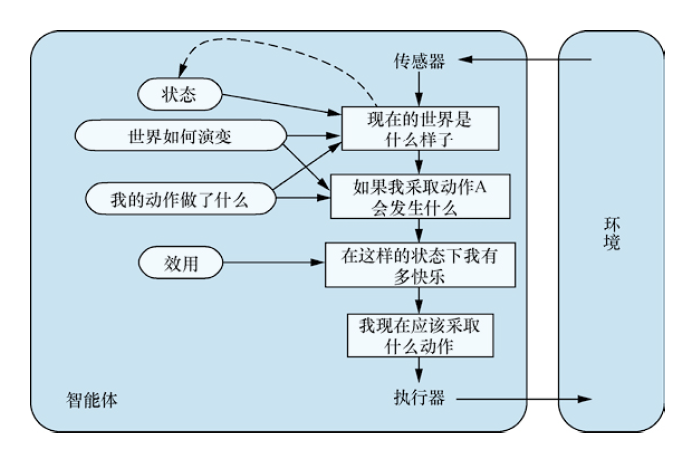

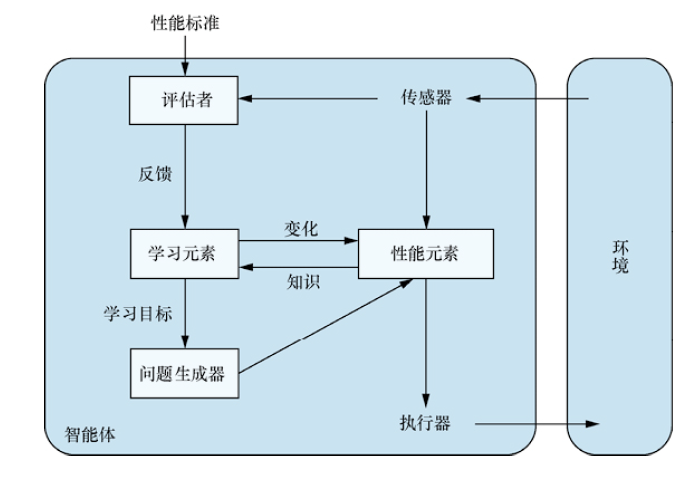

任何通过传感器感知环境并通过执行器作用于环境的事物都可以视为$Agent$,包括人类、机器人、软件机器人等。从数学上讲,可以说$Agent$的行为由$Agent$ $function$描述,该函数将任意给定的感知序映射到行为:

$$

f:\mathcal{P}^*\rightarrow \mathcal{A}

$$

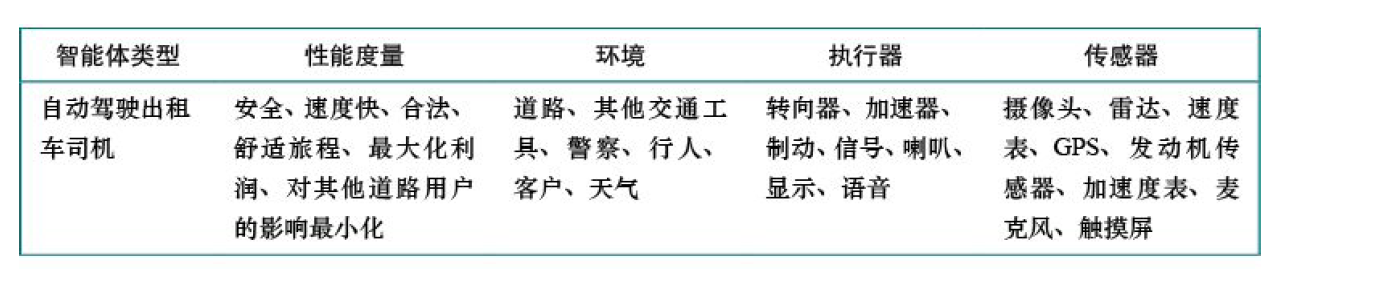

为了衡量$Agent$的效用,需要指定性能度量($Performance$)、环境($Environment$)、智能体的执行器($Actuator$)和($Sensor$),即$Agent$的$PEAS$描述。以下是一个示例:

任务环境的数学包括不同维度的描述把环境分为:完全可观测的和部分可观测的、单智能体的和多智能体的、确定性和非确定性的、回合式的和序贯的、静态的和静态的、离散的和连续的、已知的和未知的。